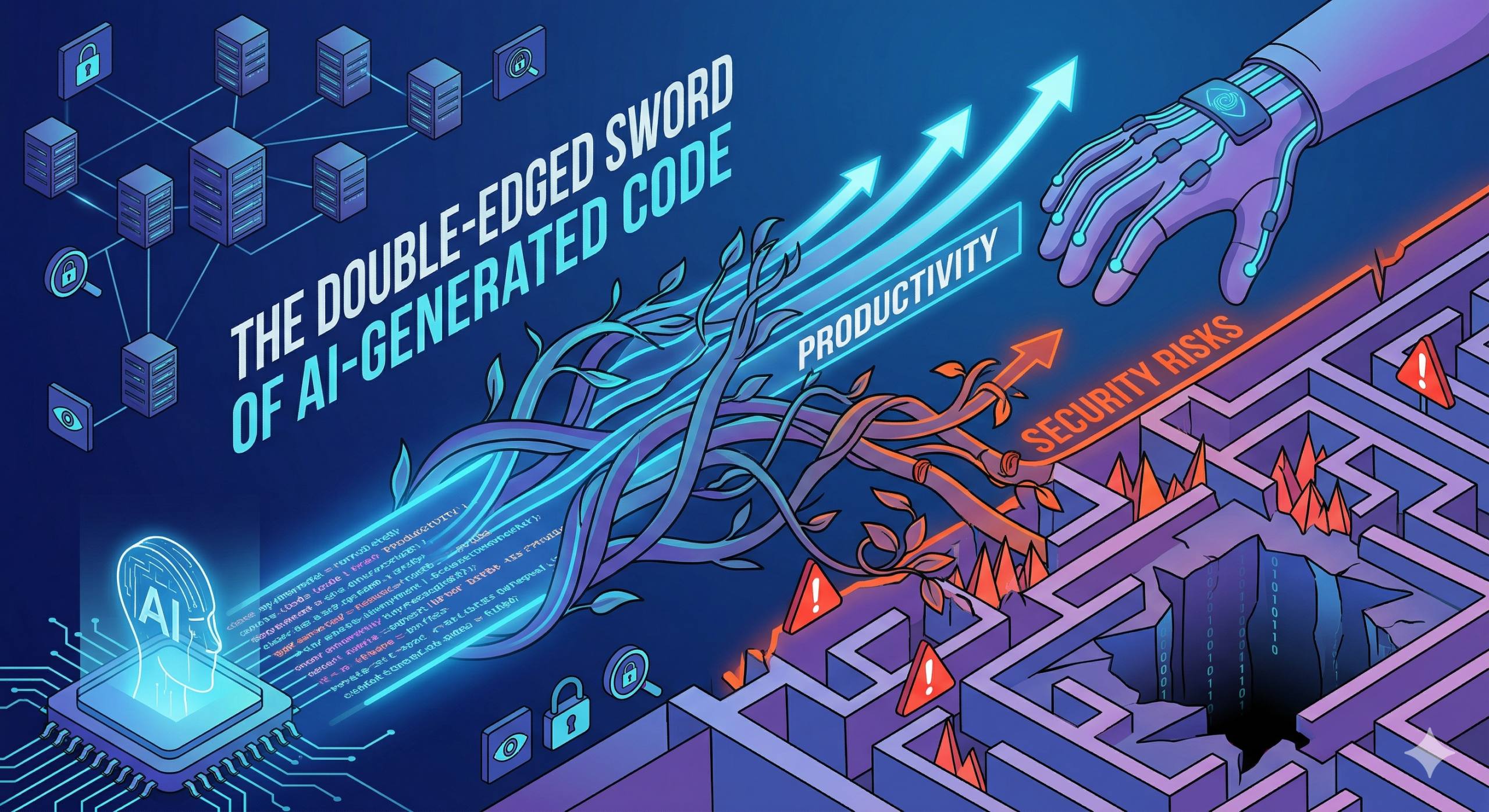

Der Hype um KI-gestützte Softwareentwicklung hat einen Namen: Vibe Coding. Man gibt einen Prompt ein, die KI liefert, der Code „fühlt“ sich richtig an und läuft. Laut aktuellen Schätzungen stammen bereits rund 40 % des weltweiten Codes aus der Feder von Algorithmen. Doch während die Release-Zyklen kürzer werden, tickt im Hintergrund eine technologische Zeitbombe.

Wenn die KI Pakete erfindet: Das Phänomen Slopsquatting

Eines der subtilsten Risiken ist das sogenannte Slopsquatting. KI-Modelle neigen bei komplexen Aufgaben zu Halluzinationen – sie empfehlen Bibliotheken, die logisch klingen, aber gar nicht existieren. Angreifer machen sich dies zunutze, indem sie diese fiktiven Paketnamen registrieren und mit Schadcode füllen. Wer den KI-Vorschlag ungeprüft per Copy-Paste übernimmt, installiert die Hintertür für Hacker quasi frei Haus. Untersuchungen zeigen, dass fast 20 % der von Chatbots empfohlenen Pakete nicht existierten – ein gefundenes Fressen für Supply-Chain-Angriffe.

Quantität schlägt Qualität: Die 10-fache Risiko-Quote

Studien von Apiiro belegen ein Paradoxon: Entwickelnde mit KI-Support schreiben zwar deutlich mehr Code, schleusen aber gleichzeitig die zehnfache Menge an Sicherheitsrisiken ein. Die KI ist hervorragend darin, Tippfehler zu vermeiden, versagt aber kläglich bei der strategischen Sicherheit.

Architekturfehler: Ein Anstieg von über 150 % bei Design-Flaws.

Rechteausweitung: Pfade für Privilege Escalation nehmen um über 300 % zu.

Blinde Flecken: Ungeprüfte Open-Source-Abhängigkeiten und hartcodierte Cloud-Credentials landen doppelt so häufig im Repository wie bei handgeschriebenem Code.

Die kritische Schnittstelle: Von der Cloud in die Werkshalle

Besonders brisant wird es, wenn dieser Code die Operational Technology (OT) berührt. Was in einer isolierten Cloud-Umgebung nur ein harmloser Konfigurationsfehler ist, kann in einem Umspannwerk oder einer Fertigungsstraße das System zum Kippen bringen. Ein fehlerhaftes Update oder ein unbedachter Netzwerk-Scan – oft durch KI-Tools ohne Kontextwissen generiert – transformiert digitale Fehler in physische Ausfälle. Der Crowdstrike-Vorfall 2024 war hierbei nur ein Vorbote dessen, was mangelnde Governance in automatisierten Umgebungen anrichten kann.

Strategie statt Verbot: Cyberresilienz als Antwort

Die Geschichte lehrt uns: Verbote von „Shadow IT“ (oder heute „Shadow AI“) funktionieren nicht. Die Lösung liegt in einer hybriden Governance-Strategie.

1. Technische Leitplanken: Unternehmen müssen auf Real-Time IDE Scanning setzen. Sicherheits-Tools sollten dort ansetzen, wo der Code entsteht – direkt im Editor. Automatisierte Tests (SAST, DAST, SCA) sind heute keine Option mehr, sondern Pflicht, um den beschleunigten Output überhaupt bewältigen zu können.

2. Der Digitale Zwilling für Assets: Resilienz bedeutet, den Überblick zu behalten. Ein digitaler Zwilling sämtlicher IT- und OT-Assets ermöglicht es, KI-generierten Code erst in isolierten Umgebungen (Sandboxing) zu testen, bevor er kritische Infrastrukturen berührt.

3. Verantwortungs-Kultur: Wir müssen weg vom blinden Vertrauen. Entwickelnde müssen geschult werden, KI als „Junior-Assistenten mit Hang zum Flunkern“ zu betrachten. Peer-Reviews bleiben unverzichtbar, insbesondere für sensible Module wie Authentifizierung oder Finanztransaktionen.

3 Key Takeaways

KI-Tools eliminieren zwar Syntaxfehler, erhöhen aber gleichzeitig die Dichte an kritischen Architektur- und Sicherheitsrisiken massiv.

Slopsquatting macht Halluzinationen zum direkten Einfallstor für Supply-Chain-Angriffe durch vergiftete Bibliotheken.

Echte Cyberresilienz erfordert eine lückenlose digitale Abbildung aller Assets, um die Auswirkungen automatisierter Code-Fehler zu begrenzen.